Parameterschätzung

- Induktive Statistik:

- nutzt Daten, um auf eine größere

Grundgesamtheit zu schließen

- fasst Daten als Realisierungen von Zufallsvariablen

auf

- verwendet Wahrscheinlichkeitsrechnung, um auf deren

Verteilungen zu schließen

- wichtige Fragestellungen

- Parameterwerte erschließen

("schätzen")

- Genauigkeit einer Schätzung quantifizieren

(→ Konfidenz-Intervalle)

- Ja-/Nein-Fragen über Daten beantworten

(→ Testtheorie)

- Statistisches Modell:

- Ausgangslage

- Grundgesamtheit mit N Elementen (N sehr

groß oder unendlich)

- Stichprobe mit n Elementen, zufällig und

unabhängig voneinander gewählt

- beobachtetes Merkmal X

- Annahmen

- Ergebnisse Xi (i=1,..,n) der i-ten

Stichprobe sind Zufallsvariablen

- Xi sind unabhängig und

gleichverteilt (i.i.d.)

- Verteilung der Xi

- unbekannt oder aufgrund von Modellannahmen

gegeben mit unbekannten Parametern

- Messwerte mit statistischen Messfehlern

häufig ~ N(μ, σ2)

- Zahl (seltener) Ereignisse pro Zeitintervall oft

~ Po(λ)

- gesuchte Information (Parameter) θ

- hat festen Wert, der aber unbekannt ist und

gesucht wird

- ist ein Vektor, falls mehrere Größen

interessieren

- Beispiele:

- Grundgesamtheit: alle von einer Maschine

bearbeiteten Werkstücke

- Merkmal: 1, falls Werkstück defekt, sonst 0

- Xi Bernoulli-Experiment mit

unbekannter Wahrscheinlichkeit p

- gesuchter Parameter θ = p

- Grundgesamtheit: alle an einem Objekt

durchführbaren Messungen einer Messgröße

- Merkmal: Ergebnis der Messung

- Xi ~ N(μ, σ2)

- gesuchte Parameter θ = (μ, σ2)

- Grundgesamtheit: alle produzierten Festplatten

eines Typs

- Merkmal: Lebensdauer

- Verteilung X der Xi unbekannt

- gesuchte Parameter θ = (E(X), Var(X))

- Mathematische Version: statistisches

Modell (𝓧, 𝓐, (Pθ)θ ∈

Θ):

- Stichprobenraum 𝓧: Menge

aller möglichen Stichproben (meistens ℝn)

- Ereignismenge 𝓐 von

Teilmengen von 𝓧: σ-Algebra der messbare Teilmengen

- Parameterraum Θ: Menge

aller möglichen Werte des Parameters θ

- Pθ (für jedes θ ∈

Θ): Wahrscheinlichkeitsmaß auf (𝓧, 𝓐)

- Schätzer für θ

(auch Schätzfunktion, Schätzstatistik):

- Idee

- berechne Größe aus den

Ausprägungen xi der Stichprobe

- verwende dies als Schätzung für θ

- Schätzer ist Abbildung T = t(X1, ...,

Xn)

- ist selbst Zufallsgröße

- Einsetzen von Ausprägungen xi

liefert Schätzung

- in Beispiel 1 etwa

- Eigenschaften von Schätzern:

- Schätzer T heißt erwartungstreu

(unbiased) :⇔

- E(T) = θ

- anschaulich: im Mittel liefert der Schätzer

den gesuchten Parameter

- mittlerer quadratischer Fehler

MSE von T

- MSE(T) = E([T - θ]2)

- für erwartungstreuen Schätzer folgt

- MSE(T) = Var(T)

- T heißt konsistent

:⇔

- anschaulich: mit wachsendem n wird die

Schätzung immer genauer

- Mittelwert-Schätzer

:

:

- gesucht ist Schätzfunktion für Erwartungswert

μ der Grundgesamtheit

- naheliegender Schätzer

- Erwartungswert von

- →

ist erwartungstreu

ist erwartungstreu

- Varianz von

- da Xi i.i.d, erhält man

- →

ist konsistent

ist konsistent

- Maximum-Likelihood-Schätzer:

- Problem: Wie findet man guten Schätzer?

- Voraussetzung: Xi hat Wahrscheinlichkeits-

oder Dichtefunktion pθ(x)

- Idee: wähle θ mit größter

Wahrscheinlichkeit, die Stichprobe zu erhalten

- definiere Likelihood-Funktion L für feste

Ausprägung x = (x1, ..., xn)

- L(θ) := pθ(x)

- Schätzer ist das θ, das L maximiert

- Eigenschaften eines Maximum-Likelihood-Schätzers

- annähernd normalverteilt für

großes n

- optimal für großes n (in gewissem

Sinn)

- nicht notwendig erwartungstreu, erst für

große n

- praktische Berechnung

- maximiere l := log(L) statt L durch Nullsetzen

der Ableitung

- ML-Schätzer für θ = (μ, σ) bei

Normalverteilung:

- bei gegebenen Messwerten xi ist die

Dichtefunktion

- ihr Logarithmus also

- mit der Ableitung

- Nullsetzen und Auflösen liefert die

ML-Schätzer

- zur Kontrolle: 2. Ableitungen sind negativ →

Maximum

- Schätzer für μ ist das bekannte

- Schätzer für σ heißt auch

- Erwartungstreuer Schätzer für die Varianz:

- Xi sei beliebig verteilt mit

Erwartungswert μ und Varianz σ2

- Berechnung des Erwartungswerts von

liefert

liefert

- also nicht erwartungstreu (erst für

große n)

- Rechnung einfach, aber länglich, s. Anhang

- erwartungstreu ist dagegen

- S2 ist wichtigster Schätzer

für die Varianz

- erklärt Definition der empirischen Varianz

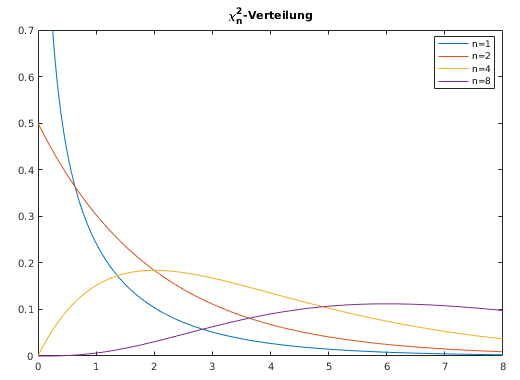

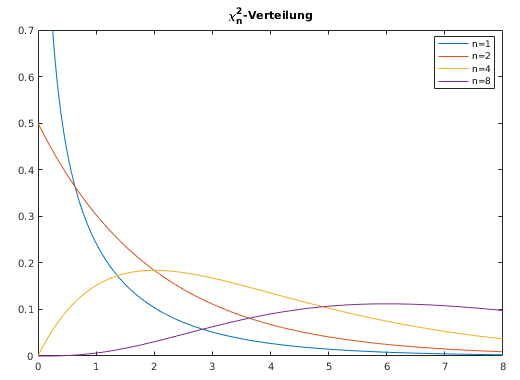

- Chi-Quadrat-Verteilung mit n Freiheitsgraden χn2:

- zur Erinnerung (s.o.):

Spezialfall der Gammaverteilung, χn2 =

γ(n/2, 1/2)

- Dichtefunktion

- graphisch

- Eigenschaften

- E(χn2) = n

- Var(χn2) = 2 n

- χn2 ist die Verteilung der

Quadratsumme von n unabhängigen Standard-Normalverteilungen

- mit Zi ~ N(0,1) i.i.d

und S2

für Normalverteilungen:

und S2

für Normalverteilungen:

- sei Xi ~ N(μ, σ2)

- Verteilung von

- Summe von normalverteilten unabhängigen

Zustandsgrößen ist normalverteilt (s.o.)

- Xi i.i.d, daher

- Verteilung von S2

- insbesondere folgt

- E(S2) = σ2

(gilt schon für allgemeine Verteilungen, s.o.)

- → S2 ist erwartungstreu und

konsistent

und S2

sind unabhängig

und S2

sind unabhängig- Beweise über Berechnungen mit Dichtefunktionen

[Kabluchko]

- Aufgaben:

:

:

ist erwartungstreu

ist erwartungstreu

ist konsistent

ist konsistent

liefert

liefert

und S2

für Normalverteilungen:

und S2

für Normalverteilungen:

und S2

sind unabhängig

und S2

sind unabhängig